今週も大きなニュースがたくさんありました!2025年3月10日から3月17日にかけて生成AI分野で話題になったニュースをまとめてご紹介します。中国Baidu(百度)やOpenAI、Googleなど主要プレイヤーの大きな動きを中心に、新しいAIツールの発表やオープンソース動向、生成AIとロボットの融合などをわかりやすくお伝えします。

1. 百度「ERNIE 4.5」と推論特化モデル「ERNIE X1」を発表

ポイント

- マルチモーダル対応:テキストだけでなく画像・音声・動画を統合的に理解・生成。

- 幻覚防止と論理推論強化:誤回答の減少と推論能力の向上で、コーディング支援の精度もUP。

- 推論特化のERNIE X1:Baidu初の「深層思考型」モデルで、コスト効率を追求。

- 無料開放と低料金API:個人ユーザー向けに無料開放し、企業向けAPIも超低価格を実現。

- 将来的なオープンソース化:2025年6月末には段階的に公開予定。

Baidu(百度)は3月16日、新モデル「ERNIE 4.5」と推論に特化した「ERNIE X1」を同時発表しました。ERNIE 4.5はマルチモーダル基盤モデルとして、テキストに加え画像・音声・動画の理解・生成を総合的に強化。幻覚(誤回答)抑制や論理推論、コーディング支援などにも重点を置いて改良されており、公式デモでは従来の中国語大規模モデルを上回る性能が示されています。

一方、ERNIE X1はチャット型AIにツール使用機能を持たせる「深層思考型」モデル。Baiduは中国の低コスト高性能モデル「DeepSeek-R1」に匹敵する性能を「半分のコスト」で実現したと主張し、国内の熾烈なAI競争における優位をアピール。さらに、ERNIE Bot(4.5を搭載したチャットAI)を個人ユーザーに無料提供し、API利用料も1000トークンあたり0.004人民元(約0.08円)からと破格に設定することで、市場シェア拡大を狙う姿勢です。

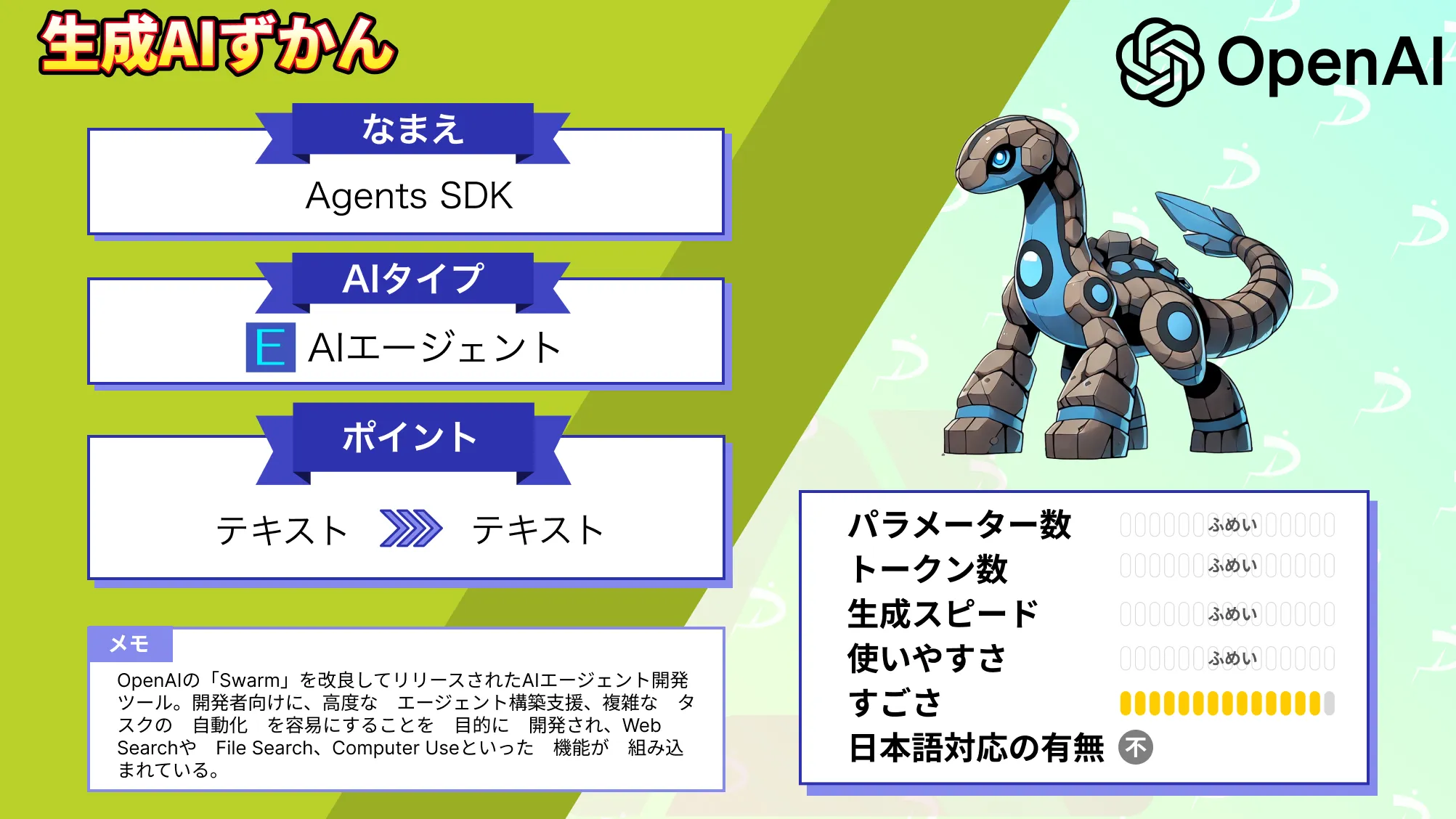

2. OpenAI、開発者向け「Agents SDK」を発表

ポイント

- エージェント開発のフレームワーク:複数AIエージェントを組み合わせたワークフローを簡単に構築可能。

- Responses APIとの統合:ChatGPTを含むすべての現行OpenAIモデルをサポートし、ツール連携機能も標準搭載。

- 安全対策と可視化:不適切応答防止のガードレールや、エージェント間のやり取りをトレースできる機能を提供。

- 開発事例:米Coinbaseが数時間でプロトタイプを制作、暗号資産ウォレット連携を実装。

OpenAIは3月11日、開発者がマルチステップで動作するAIエージェントをより簡単に構築するための「Agents SDK」を公開しました。これは複数のLLM(大規模言語モデル)を連携させ、ユーザーからの指示や外部ツールの呼び出しなどを統合的に扱うオープンソースフレームワークです。Agents SDKは新しいResponses API上で動作し、Web検索・ファイル検索・コンピュータ操作など、主要なタスク向けビルトインツールもあらかじめ組み込まれています。

従来、AIエージェントを開発する際はチャットモデルに複雑なプロンプト設計や独自コードが必要でしたが、Agents SDKの登場により、そうした開発フローが大幅に簡略化されると期待されています。OpenAIは「トレース機能」や「ガードレール」など安全策も強化し、企業が高速かつ信頼性の高いAIエージェントを組み込めるよう配慮している点も注目されます。

3. Google「Gemini Robotics」:ロボティクス領域へAIを拡張

ポイント

- ロボットへの直接制御:視覚・言語・動作(VLA)モデルとして、ユーザー指示を物理的動作に変換。

- 未知物体への対応力:複雑な空間認識と柔軟な操作が可能。折り紙や掃除などの繊細タスクにも対応。

- Gemini Robotics-ER:強化版モデルで物体の掴み方や動作方法を自動推定し、高度なEmbodied Reasoningを実現。

- ロボット企業との連携:ApptronikやAgility Roboticsなど複数社と提携し、安全性検証を進行中。

Google DeepMindは3月12日、最新汎用AIモデル「Gemini 2.0」をロボティクスに展開した「Gemini Robotics」を発表しました。従来のマルチモーダル(テキスト・画像・音声・動画)に加え、物理的な動作まで出力できる「VLA(Vision-Language-Action)モデル」が大きな特徴。ユーザーが口頭やテキストで指示すると、ロボットが周囲環境を把握しながらタスクを遂行します。

さらに派生モデル「Gemini Robotics-ER」では、物体形状を見ただけで最適な掴み方や操作方法を推定するなど、身体性推論を含む先進機能を搭載。Googleは人型ロボットなど様々な形態のロボットにこのAIを組み込む方針で、将来的に日常生活のアシスタントや工場でのオートメーションなど、多岐にわたる応用を見据えています。

4. Google「Whisk」で画像合成を直感的に

ポイント

- 画像をプロンプトに:テキストを使わず、合成したい画像そのものを入力することで新しい画像を生成。

- Imagen 3モデルを活用:高精細な画風・アニメ調から写真写実まで幅広く表現。

- 「主体」「背景」「スタイル」を指定:ぬいぐるみ風やピンバッジ風など多彩なアレンジが可能。

- クリエイターに優しいUI:Google Labs上で提供、日本を含む100か国以上で順次アクセス可能。

Googleは画像そのものをプロンプトとして活用し、別のスタイルにリミックスできる新ツール「Whisk」をリリースしました。ユーザーは「主体」「背景」「スタイル」の3要素に任意の画像(またはテキスト)を組み合わせるだけで、AIが自動的にキャプション化し、Imagen 3を使った高品質な合成画像を生成してくれます。

たとえばお気に入りのキャラクター写真をぬいぐるみ化したり、ピンバッジ風のイラストにしたりと、テキストプロンプトだけでは難しい「目で見てわかる」指示が可能に。Googleによると、Whiskはクリエイターだけでなく一般ユーザーにも直感的に扱える新しいビジュアル制作ツールとして活用が期待されています。

5. その他の注目トピック

Alibaba Cloud「QwQ-32B」モデル

- 効率的な推論モデル:わずか32億パラメータながら、大規模モデルDeepSeek-R1級の性能を発揮。

- オープンソースと商用利用可:必要計算資源を大幅削減し、研究者や企業に門戸を開放。

- 参考: VENTUREBEAT.COM

Anthropic「MCP(Model Context Protocol)」

- 汎用AIの外部連携標準:LLMと外部データソース・ツールを安全かつ双方向に結ぶ共通プロトコル。

- OpenAIのAgents SDK対抗:企業が機密データを扱う際のセキュリティ・規格化を重視。

- 参考: SECURITYBOULEVARD.COM

Meta「コミュニティノート」導入

- Facebook/Instagram向け:ユーザー参加型のファクトチェック機能を米国でテスト開始。

- Twitter(X社)手法を参考:複数ユーザーの評価により誤情報投稿に注意書きを付与。

- 生成AIの直接ニュースではないが…:大規模SNSがオープンソースアルゴリズムを使う「自律型チェック」の動きとして注目。

- 参考: REUTERS.COM

まとめ

2025年3月11日から3月17日にかけては、中国BaiduやOpenAI、Googleをはじめとする大手各社が新たなAIモデルや開発フレームワークを一斉に発表する非常に活気ある一週間となりました。ロボットへの直接制御を可能にする「Gemini Robotics」や画像を直感的に組み合わせる「Whisk」のように、生成AIがテキストだけでなく映像や動作の分野にも大きく進出している点は特に注目です。

一方で、AlibabaやAnthropicが推し進めるオープンソースや共通プロトコルの流れ、そしてMetaのコミュニティノート導入など、AI技術が社会全体で広く利用されるための仕組み作りも加速しています。今後も主要企業の競争や、法規制・倫理への対応など多岐にわたるトピックから目が離せません。次のアップデートを楽しみに待ちましょう。