こんにちは、中村稔です。今日は生成AIに関する最新のホットなニュースをお届けします。アメリカと日本の最新情報を中心に、5つの注目すべきトピックスを取り上げてみました。それでは早速見ていきましょう。

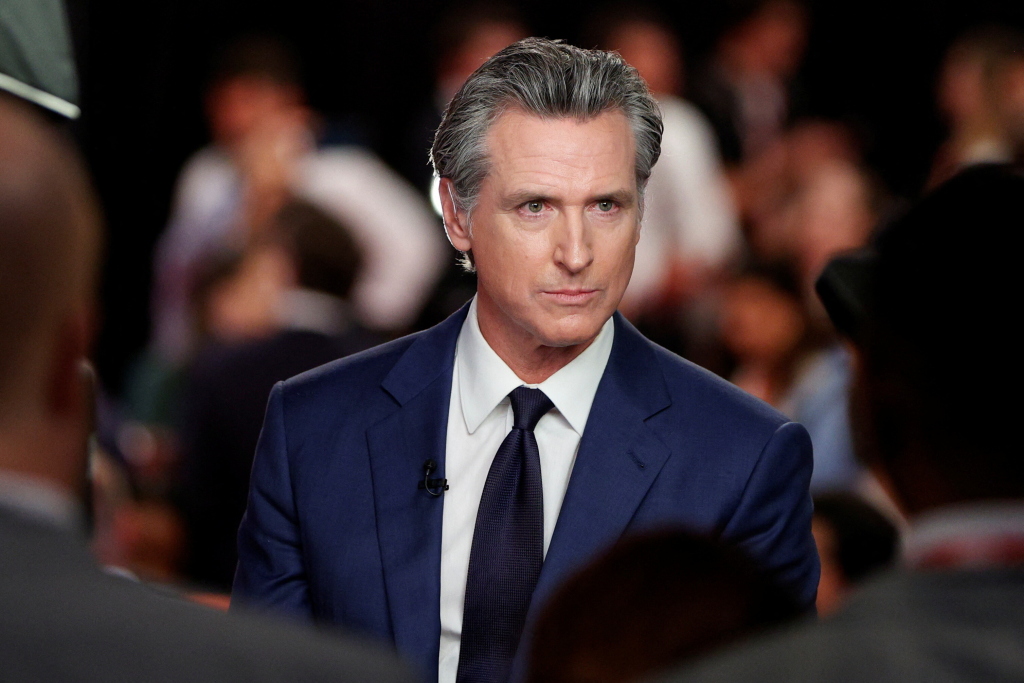

カリフォルニア州知事がAI規制法案を拒否

カリフォルニア州のギャビン・ニューサム知事が、同州で提案されていたAI安全法案を拒否しました。この法案は、アメリカで初めてとなるAIに関する法規制を導入しようとするものでした。ニューサム知事は声明で「これは技術がもたらす実際の脅威から公衆を守るための最善のアプローチだとは思えない」と述べています。知事は、AI規制は「技術そのものと歩調を合わせる必要がある」と指摘。「この技術が公共の利益を推進する可能性を阻害することなく、リスクを軽減し脅威から保護する道筋を見出すことに尽力する」と表明しました。この法案は、最先端のAIモデルに安全性テストの実施を義務付け、開発者にAIシステムを隔離・遮断する「キルスイッチ」の実装を強制するなど、かなり踏み込んだ内容でした。大手テクノロジー企業からの強い反対もあり、知事の判断に至ったようです。AIの規制をめぐっては、イノベーションを阻害しない範囲でどこまで規制するかが世界的な課題となっています。カリフォルニア州の動向は、今後のアメリカ全体のAI政策にも大きな影響を与える可能性があり、注目が集まっています。

https://www.weforum.org/agenda/2024/10/ai-safety-children-online-safety-digital-tech/

トヨタシステムズ、生成AIで基幹システム更新作業の効率化に成功

トヨタシステムズが基幹システムの更新作業に生成AIを活用する実証実験を行い、従来比約50%の作業量削減に成功したことが明らかになりました。トヨタシステムズはトヨタグループの生産や物流、販売などの基幹システムの開発・運用を担う企業です。今回の実証実験では、Javaおよび SQLJで開発された約1万5000ファイルを対象に、「生成AIが非互換情報に基づいて影響が予想される非互換箇所を抽出し、プログラムを修正できるか」を検証しました。その結果、修正の正確さが確認できただけでなく、作業時間も約50%削減できることが分かりました。基幹システムのアップデートは、セキュリティの観点から重要ですが、調査や互換性検証、アプリケーションの修正、テストなど、膨大な作業工数が必要になります。生成AIの活用により、この課題を大幅に改善できる可能性が示されたと言えるでしょう。トヨタシステムズと富士通は今後、JavaやSQLJ以外のプログラミング言語やテスト工程にも生成AIの適用範囲を拡げ、さらなる生産性向上を目指すとしています。自動車業界の巨人であるトヨタグループでのこの成功事例は、他の製造業にも大きな影響を与えそうです。

https://www.itmedia.co.jp/enterprise/articles/2410/28/news075.html

米国と英国、子どものオンライン安全に関する共同作業部会を設立へ

アメリカとイギリスの政府が、子どものオンライン安全に関する新しい共同作業部会を設立・立ち上げることを発表しました。イギリス政府の声明によると、現在「ソーシャルメディアが子どもや若者に与える因果的な影響に関する研究や証拠は限られている」とのことです。作業部会が設立されれば、プラットフォームの透明性向上などの分野で活動する予定です。また、両国は安全技術や生成AIの影響に関する専門知識も共有します。イギリスのピーター・カイル技術担当大臣は「オンラインの世界は若者に信じられないほどの利益をもたらし、教育や社会生活を豊かにします。しかし、これらの経験は、安全性が最初から組み込まれた環境で行われなければなりません」と述べています。子どものオンライン安全は世界的な課題となっています。特に生成AIの登場により、新たなリスクも生まれています。日本でも同様の課題に直面しており、この米英の取り組みは参考になるのではないでしょうか。

https://www.weforum.org/agenda/2024/10/ai-safety-children-online-safety-digital-tech/

大規模言語モデルの新バージョン、無知を認めるより間違った回答を生成しやすい傾向に

新しい大規模な人工知能チャットボットの3つの主要バージョンは、無知を認めるよりも間違った答えを生成する可能性が高いことが研究で明らかになりました。また、一般的に人々はこれらの間違った回答を見抜くのが得意ではないことも分かりました。この研究結果は、生成AIの信頼性に関する重要な問題を提起しています。AIが自信を持って間違った情報を提供し、それを人間が見抜けないとなると、誤情報の拡散や意思決定の誤りにつながる可能性があります。特に教育や医療、法律など、正確な情報が重要な分野での生成AIの利用には慎重な対応が必要かもしれません。また、AIリテラシー教育の重要性も改めて浮き彫りになったと言えるでしょう。生成AIの進化は目覚ましいものがありますが、同時にこうした課題も顕在化しています。技術の発展と並行して、AIの限界を理解し、適切に利用する能力を身につけることが私たち人間側にも求められているのです。

https://www.weforum.org/agenda/2024/10/ai-safety-children-online-safety-digital-tech/

インド中央銀行総裁、AIの金融安定性リスクを警告

インド準備銀行(中央銀行)のシャクティカンタ・ダス総裁が、AIの金融リスクについて警鐘を鳴らしました。ダス総裁は、AIや機械学習を含む技術の金融サービスでの利用拡大が金融安定性に影響を与える可能性があると指摘しています。金融分野でのAI活用は、リスク評価の精度向上や業務効率化など多くのメリットがある一方で、新たなリスクも生み出しています。例えば、AIモデルのバイアスによる不公平な融資判断や、AIシステムの脆弱性を突いたサイバー攻撃などが懸念されています。また、AIによる高頻度取引が市場の不安定性を高める可能性や、AIモデルの「ブラックボックス」問題により、金融機関のリスク管理が困難になる可能性も指摘されています。インドは急速にデジタル化が進む巨大市場であり、ダス総裁の発言は国際的な注目を集めています。各国の金融当局は、AIがもたらす恩恵を最大化しつつ、そのリスクをいかに管理するかという難しい課題に直面しています。日本を含む先進国の金融機関も、この問題に対する取り組みを強化する必要がありそうです。

https://www.weforum.org/agenda/2024/10/ai-safety-children-online-safety-digital-tech/

以上、生成AIに関する最新ニュースをお届けしました。技術の進歩と同時に、規制や安全性、倫理的な課題も浮き彫りになってきています。これらの課題にどう向き合っていくか、私たち一人一人が考える必要がありそうです。今後も引き続き、生成AI業界の動向に注目していきましょう。